Kunstig intelligens brukes nå aktivt i krig, men eksperter advarer om lav treffsikkerhet og manglende kontroll. Hva som faktisk skjer bak kulissene, er fortsatt uklart.

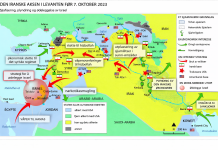

Bruken av kunstig intelligens i krig har fått økt oppmerksomhet etter angrepene mot Iran i slutten av februar. USA og Israel skal ha truffet over 1000 mål det første døgnet alene, skriver France 24.

Senere opplyste den amerikanske generalen Brad Cooper at mer enn 5500 mål var rammet. Han trakk fram kunstig intelligens som en viktig del av operasjonene.

– Mennesker vil alltid ta de endelige beslutningene om hva som skal angripes og når. Men avanserte AI-verktøy kan gjøre prosesser som før tok timer eller dager, unna på sekunder, sa han.

Kan gjøre krig raskere

Flere land tar nå i bruk slike systemer i militæret. Også Israel, Kina, Russland, Frankrike og Storbritannia utvikler lignende løsninger.

Forskere mener teknologien særlig brukes til å gjøre det som kalles en «drapskjede» mer effektiv – altså hele prosessen fra overvåking til angrep.

– Det handler om overvåking, innsamling av informasjon, valg av mål og til slutt angrep, sier forsker Heidy Khlaaf.

Hun forklarer at kunstig intelligens kan kutte tiden kraftig.

– Ett system hevder at 20 personer kan gjøre jobben til 2000. Det som selges inn her, er fart.

Men hun stiller spørsmål ved hvor god kontroll mennesker egentlig har.

– Folk har en tendens til å stole på anbefalinger fra maskiner. I praksis blir kontrollen overflatisk, særlig i militæret.

– Mennesker blir bare gummistempler. Da er vi nær systemer som i praksis tar avgjørelser selv, sier hun.

Les også: Kina vil fjernstyre insekter 🔒

Lav treffsikkerhet

En annen bekymring er hvor presise systemene er. Ifølge Khlaaf kan noen AI-modeller ha så lav treffsikkerhet som 50 prosent – eller enda lavere.

– For systemer som velger mål, kan treffsikkerheten være nede i 25 til 30 prosent i enkelte tilfeller.

Hun peker på at moderne systemer må analysere enorme mengder data.

– Når én modell må gå gjennom milliarder av datapunkter, er det vanskelig å vite hvor feilene oppstår.

I tillegg er mange av systemene såkalte «svarte bokser», der selv brukerne ikke forstår hvordan de fungerer.

– Det er et stort problem. Vi vet ikke om angrep skyldes feil, dårlig informasjon eller svakheter i systemet, sier hun.

Kan øke faren for eskalering

Forskning tyder også på at kunstig intelligens kan gjøre konflikter farligere.

I en studie ble flere AI-modeller testet i simulerte atomkriser. Resultatet var tydelig.

– Bruk av atomvåpen dukket opp i nesten alle scenariene, sier Khlaaf.

Hun mener dette bør tas på alvor.

– Det finnes mye forskning som viser at AI kan øke risikoen for opptrapping. Dette bør ikke være i nærheten av menneskeliv.

Til tross for den raske utviklingen, er det fortsatt uklart hvor nyttig teknologien faktisk er i krig.

– Det snakkes om et kappløp om AI. Men vi vet ikke om teknologien faktisk fungerer slik man håper, sier hun og avslutter:

– USA blir sett på som et forbilde, men dette bør heller være en advarsel.

Den kunstige revolusjonen – den fjerde industrielle revolusjon 🔒